「你想喝點兒什麼嗎,羅布?」我問道,其實我自己非常想來一杯烈酒。

「不用了,先生,謝謝。」

過去的16年裡,這個場景在我的腦海中出現過無數次,我想每一位父親都幻想過。我女兒梅拉妮的第一個約會對像——至少是第一個來我家裡接她的傢伙。羅布是一個懂禮貌、相貌英俊的小伙子,他體格健壯,有著淡棕色的皮膚和深邃的藍眼睛。梅拉妮和她媽媽芭芭拉去樓上收拾東西準備出門。在我倆最初的談話中,我發現羅布是一位非常有魅力的談話高手。當我對他問的一些問題做出回應時,他看起來似乎真的很感興趣,表現得幽默風趣而又不失禮。我能看出來梅拉妮為什麼會喜歡他,這也是我一直努力克制自己不表現出反對的原因。

羅布是個機器人。

在羅布拜訪的前一晚,梅拉妮才告訴我這個消息。芭芭拉和我一直在追問她有關這個神秘人物的信息,終於,梅拉妮說他要過來了。

哦,對了,他是個機器人。或者用她的話說,是「以肉體形式呈現的自動化智能」。

到2028年,人性化機器人在外形上已經達到了極其先進的水平。只有很少的假動作或特點能讓人想起來它是個機器人,「恐怖谷」效應已經不復存在。在大約15年前開始的自動化浪潮中,公司高管們開始用機器人取代勞工,因為他們認為機器能從消費者身上獲得獨特的市場洞察。

起初,大多數公司機器人長得都很像《超能陸戰隊6》裡十分可愛、圓滾滾的大白。隨後,當人們習慣把機器人做成很像人的可愛形象時,開始有公司生產人形的品牌機器人,能夠最大限度地契合附近社區消費者的人口統計學數據。在田納西州的亨德森維爾,華夫餅餐廳的機器人店員長得很像著名歌手凱莉·安德伍德。在布魯克林的星巴克店裡,給人們端拿鐵咖啡的帥哥酷似布魯諾·馬爾斯。幾年的時間裡,機器人設計得到了極大的提升,遍佈各地的不再是只有幾種版本的男女機器人。公司的算法能把機器人、人及其周圍的相關物體聯繫起來,並預測某個消費者在公眾場合想跟哪種界面打交道,然後在消費者的購買過程中,機器人便能呈現出跟消費者的預期別無二致的模樣。

在波及範圍廣泛的自動化浪潮中,我有很多朋友都失去了工作。我也是通過強調自己是個「人類記者」,才勉強保住了作為技術作家的飯碗。剛開始這只是個笑話,但當人類記者開始被人工智能程序取代時,管理層覺得如果有一個人類記者的話,在進行技術方面的報道時,就能夠保持客觀,這是來自硅谷的機器人記者所不具備的。

直到現在,人們與機器人的直接接觸大多停留在購物或像星巴克這樣的服務場所的範圍內。沒錯,多年來情色機器人一直保持著強勁的生命力。我有好幾次出差的時候都發現,一些比較前衛的賓館開始將機器人「服務」列入「成人服務」項目中。

但這個機器人卻在和我女兒約會。這可是我的梅拉妮。我知道羅布在技術先進程度方面遠遠超過了蘋果手機或智能冰箱,但在他面前,我還是忍不住會產生一種強烈的反感,儘管我非常努力地保持禮貌。我知道他身上裝著面部識別和生理感應的追蹤裝置,能夠識別出我的恐懼。我心跳加速、瞳孔擴大,羅布身上的技術能夠輕而易舉地把這些反應和緊張聯繫起來。但願他沒有把數據實時傳送到他的博客或其他社交渠道上。我都能想到這樣的推特標題:女友的父親因我不是「人」而嚇壞了#機器人——種族歧視。

「黑文斯先生。」羅布說道,打斷了我的思緒。他的聲音降了八度,響亮的男中音讓我鎮定下來。雖然我能肯定這是他身上的部分程序,但這還是發揮了作用。「我是個機器人,我覺得這讓你感覺很奇怪。」

我點點頭,聽到樓上傳來梅拉妮和芭芭拉的笑聲。「是的,羅布,不好意思。我一直驕傲地以為自己很開放、能容忍,但我至今還在努力理解你們倆的關係。我覺得我還是有些思想守舊。」我停下來,清清嗓子,想著該說什麼,「我想問你父母是否也是這樣老派,但我猜你的創造者應該是某種先進的算法,或者是一群二十出頭的程序員。」

「爸爸!」梅拉妮站在樓梯上,穿著低胸紅色上衣和流行牛仔褲,非常漂亮。「真不敢相信你說了那些話。」她和芭芭拉一起走下樓梯,她拉住了羅布的手,「對不起,羅布。我早跟你說了,他肯定會嚇壞的。」

羅布對梅拉妮笑了笑,然後轉向我妻子,「你好,黑文斯太太,很高興能見到你。」

「你好,羅布,」她答道,快速地和他握了握手,然後把兩臂交叉在胸前,「很高興見到你。」芭芭拉的表情就好像她剛剛活吞了一隻大黃蜂。

梅拉妮看了看芭芭拉,「媽媽,你也嚇壞了嗎?你在樓上的時候都還挺好的呢。」

「嗯。是的,我想應該沒事。」芭芭拉很不自然地對我笑笑,「或者說,我想我應該是高興的。」我倆之前已經討論過在見到羅布時該怎樣表現。我倆很想表現出親切的樣子,但事實上這太難了。

「電腦該怎麼稱呼它的父親呢?」羅布說道,想打破緊張的沉默,「順便說下,這只是個笑話。」

梅拉妮轉動了下眼睛。芭芭拉和我看著羅布,沒有說話。

羅布笑著說道:「Data」(數據),故意發音很像dada(爸爸)。

我想起來這個笑話來自電影《她》,傑昆·菲尼克斯是其中的主演,便大笑起來。「我很愛看那部電影。但斯嘉麗·約翰遜演的人工智能機器人只不過存在於傑昆·菲尼克斯的大腦裡。我是說,她的聲音是真的,而且隨著跟菲尼克斯相處的時間越來越長,她的算法也不斷改進,但她並沒有你這樣的外形。」

「爸爸,」梅拉妮生氣地漲紅了臉,「你知道你說的是多麼私人的話題嗎?」

我真的不知道。「私人的?」我看了看羅布,「私人?這個詞用到這裡合適嗎?我是在很認真地問你,我真的很想知道。」

梅拉妮緊緊抓住羅布的手,「你不用回答他的問題。」

「沒事,這沒什麼,梅拉妮。別忘了,我是不會真的感到被冒犯的。如果你爸爸的聲音中透露出一絲羞愧的話,這就意味著他是在開玩笑,故意假裝不懂,那麼我就會表現出被冒犯的特點。」他朝我盯著看,我能看出來他是在判斷我的情緒。「但我沒有看到羞愧。這對他來說是一次新體驗,他有點兒害怕,這很正常。但他的聲音有些憂鬱,他問的問題也是出於一位父親對孩子的保護欲。」他看了看梅拉妮,笑著說,「這是因為他的小女兒長大了。不能因為這個責怪他。」

我伸手去抓芭芭拉的手。我沒有預料到羅布會說出這麼深刻的話。儘管我知道他只是簡單地報告對我的掃瞄數據,但這也太過準確了。的確,我剛剛雖然無意,但行為很冒犯,而羅布對此的反應卻那麼友善。儘管我知道他的反應是被人設計的,而且他的程序設定了恰當的反應時間,使用的是一種能夠精準地激發我們的同情心的聲音,但這毫不影響我對他的友善而產生的好感。

一想到我的梅拉妮漸漸長大,我感到有些哽咽,芭芭拉的眼睛也濕潤了。不管是哪種計算程序讓羅布識別出了身為父母的恐懼,我們都被深深地打動了。

而這讓我越發害怕了。

反映我們數字身份的數據

2013年,我參加過一次TEDx討論會。會上我在演講開始的時候引用了「我同步故我在」的話。這是根據現代哲學之父勒內·笛卡兒的名言進行改寫的。他的原話是「我思故我在」(拉丁文是Cogito, ergo sum),同行評議哲學網站——互聯網哲學百科全書對它的定義如下:

不論我的思想正確與否,我在思考的事實本身就表明肯定有一個執行思考行為的主體,即「我」。由此可以推出「我存在」的命題,所以說,我們可以從某些絕對存在的真理信仰中推斷出其他絕對真理。

我喜歡笛卡兒的這句格言,因為它非常簡潔。儘管我的某些想法可能有些瘋狂或偏激,但如果我擁有這些想法並能意識到有這些想法的話,那麼我就是存在的。這在真實或物質世界中是講得通的,因為在這裡我們對自己的思想和身份具有能動作用。我說的「能動作用」就是控制的意思。或許你不喜歡我所表達的想法,而且如果這些話不幸對某人造成誹謗的話,我可能還會因此而鋃鐺入獄,但除非我被麻醉了或者死了,我的思想仍然歸我自己所有。我創造了我自己的思想這一事實就是我存在的依據。

我用「同步」一詞,指的是一種數據輸入過程,這些數據和我們在互聯網或其他數字或虛擬世界的身份相關。這還包括他人對該數據的反應,網站上進行軌跡追蹤的Ccookie設置即是如此。大多數人談到數據同步時,腦海裡想的只是他們創造的臉譜網帖子、推特文章或者YouTube上的視頻,但如今大部分和我們相關的信息記錄過程都是在我們日常生活的大背景中完成的。

例如,在高速路上行車時,你會不會使用快易通(E-ZPass)或其他自動收費系統?當你從收費點駛過時,你的行車地點和時間數據都被記錄了下來,而且還會通過你的信用卡支付通行費。再舉個例子,你有沒有惹惱過配備可穿戴情緒監測設備的同事?你的行為或許讓他們頗有壓力,那麼如果你同事把數據拿給你老闆看的話,你可能就會被炒魷魚。在2013年發表於《衛報》上的一篇文章中,我虛構了一個類似的場景,故事講的是一名女職工通過追蹤經理恃強凌弱的行為,並證明這種行為對其健康產生了不利影響,從而成功地讓該經理被解雇。

但時至2014年11月,這種數據責任制就已經變成了現實。對此,凱特·克勞福德在發表於《大西洋月刊》上一篇題為「當活動智能設備成為專業證人」的文章中有所描述。以下引文是其文章的開頭:

用可穿戴設備進行自我追蹤真的非常令人神往。它可以督促你多多運動,讓你反思自己睡得有多麼多(或者少),且有助於長期監測你的心情規律。但當你使用可穿戴設備時,也會引起其他的變化,這種變化可能不會立馬表現出來:你不再是自我數據的唯一來源了。日子一天天過去,你在無意識中創造的數據也被一點點地記錄並保存下來。而如今,這些數據可能會在法庭上被當作對你不利的證據而使用。

可穿戴設備其實就和電腦或手機一樣,只不過外形不同而已。如今,在我們買東西的商店,在我們的家用電器中,甚至可能在我們身體裡的各種醫療裝置上,隨處可見這種設備傳感器。事實上,你根本沒有意識到自己有多麼頻繁地在進行數據同步,而這恰恰說明了該設備被動收集並悄悄傳播信息的本質,這也是其設計的一個初衷。或許在將來的某一天,這些可穿戴設備可能會以私人機器人助手的形式出現,你和你的朋友可能都會有。

或者,還會出現跟你女兒約會的機器人。

回顧:

作為一個非數字實體,你思故你在。你的思想讓你與眾不同。

作為一個數字實體,你的身份同步與解讀需要結合其他無數的行為主體進行。

我把我們生活周圍的數據同步稱為「人工」智能的一種,因為其設計初衷便是在我們的意識沒有參與時對我們的生活進行追蹤。以這種方式收集的數據常常都是錯誤的。我曾參加過一個會議,在一次關於數據代理的討論中,參會的一位中年白人提到,他曾通過數據代理公司安客誠(Acxiom)獲得了自己的個人信息。根據數據顯示,他是千禧一代的黑人,現居州也跟其實際居住地不同。

這就是反映我們數字身份的數據的現狀。

恐怖谷效應

2009年,迪士尼樂園對其具有代表性的總統館進行了升級,把貝拉克·奧巴馬也囊括其中。你可以在YouTube上看到奧巴馬的電子動畫演講視頻,該視頻採用了真聲錄音。20世紀70年代,當我還是小孩時,我第一次在奧蘭多參觀了迪士尼樂園總統館,亞伯拉罕·林肯的一舉一動都顯得笨拙而又虛假。而在如今的新一代作品中,迪士尼視頻裡的奧巴馬機器人四肢靈活,從座椅上起身的喬治·華盛頓看起來也活靈活現,這些都讓我印象深刻。但當機器人開始說話時,他們的嘴型和話語就對不上了,面部表情也看起來單調而恐怖。小的時候,我知道這些其實都是機器,經常一邊嘲笑其僵硬虛假,一邊又緊貼著我媽媽,生怕傑拉爾德·福特因為我不讚賞他在展覽中的樣子而刺瞎我的眼睛。

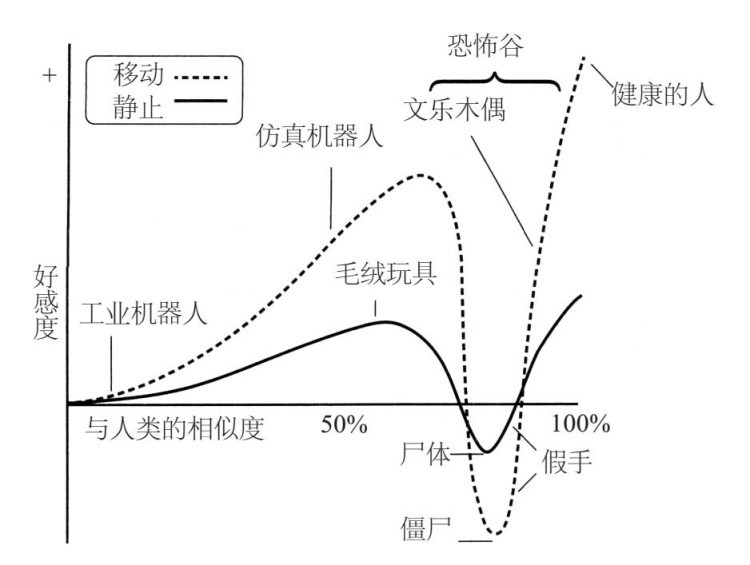

這種對缺乏完整人性的機器的恐懼和厭惡就是所謂的恐怖谷效應。這個詞是1970年由東京工科大學工程學教授森政弘(Masahiro Mori)博士創造的。他還製作了一個著名的圖表(出自維基百科)。該圖描繪了人類的哪些外形特點能夠增強人們對機器人的肯定,以及哪些特點可能會讓機器人看起來過於逼真,從而引起人們的反感。

在觀看木偶戲時,如果天才表演家能把木偶主角表現得栩栩如生的話,觀眾也可以感受到恐怖谷效應。當我們觀看波士頓動力公司(曾被谷歌收購)設計的機械狗的視頻,看到機械狗在山巒起伏的冰原間穿梭而永不落地時,我們也有這樣的感受。機械狗沒有頭的外形令人心生不安,既然它可以看起來這麼泰然自若,那也意味著它可以輕易地闖入你的家中,把你殺死在睡夢中。

以上這些玩笑話只能稍稍遮掩幾分恐怖谷這個概念所隱含的那種恐懼,尤其在談到機器人掌控我們的生活這個問題時,就更難掩蓋了。根據印第安納大學的卡爾·F·麥克多曼教授的說法,我們在這些場景中所體驗到的恐懼是對人類必死命運的「動物性暗示」,克裡斯·韋勒在《醫學日報》上也曾對此有過報道。作為人類,我們必然是要面臨死亡的,而總統館裡的機器人只需要保養就可以一直存在。

對虛擬關係的嚴重依賴

在我有生之年,我們對技術的依賴大大增強,甚至到了我時不時會在互聯網面前感到悵然若失的地步。我的家鄉新澤西州曾受到超級風暴「桑迪」的重創,100多人在這場災難中喪生,超過800萬戶家庭斷電。冬天最冷的時候,我家斷了大半個星期的電,我們只得擠在移動取暖器周圍,供電的發電機是從姐夫家借來的。風暴來襲時正值萬聖節期間,所以整個城市把假期往後推遲了,孩子們可以在11月初玩萬聖節「不給糖就搗蛋」的遊戲。

那一晚過得跟做夢似的。一方面,風暴讓人與人之間變得更加友善。在孩子們通過訴說自己在風暴中的遭遇,利用家裡斷電和受到的損失博得同情,以此來獲得糖果的同時,我和很多家長也得以閒聊,互相交換到哪裡去加油的信息,因為去當地的加油站都要等上好幾個小時。

另一方面,那晚明顯有一種恐慌的氣氛。每隔四五條街便有一個發電機在工作,嗡嗡聲不絕於耳,觸手般的電源線從破碎的窗子裡蜿蜒著伸出來,把這種恐慌氣氛烘托得更加強烈。整個城區已經斷電好幾天了,沒有發電機的人開始羨慕有發電機的人。發電機有起火的危險,所以必須得放在戶外。我們那裡發生了好幾起發電機偷盜案件,所以我用車鎖把我們的發電機鎖在了柵欄上。雜貨店裡就跟《蠅王》裡的情景一樣,人們開始貯存瓶裝水、罐裝食品等必需食品。當圖書館恢復了通電,而城裡大多數人家裡都還沒電時,人們一窩蜂地湧進去給自己的電腦、蘋果手機和黑莓手機充電,這簡直就跟沙漠中的水泉一樣重要。而其中頗具諷刺意味的是,這個致力於公共教育的機構在沒有發放一本書的情況下,滿足了我們對信息的渴求。

這些場景之所以讓我記憶深刻,是出於以下原因。第一,當時的情況非常令人不安。鎮上我認識的每一個人家裡都遭受了至少幾百或幾千美元的損失,而即便這樣,我們還是其中的幸運兒。在澤西海岸,很多人在風暴中喪生,很多社區的人全都沒了房子、店舖及生計。

第二,我發現,在危機時刻身為父母的人是多麼容易就變得自私起來。儘管我們主動提出要為鄰居提供一些幫助,例如用我們的發電機給他們的設備充電,但我感受到了一種異乎尋常的衝動,我想要保護妻子和孩子不受風暴及其餘波的影響。雖然我外在的表現還是很文明優雅,但自私的衝動卻佔據了我大部分的內心活動。

此外,超級風暴「桑迪」也讓鎮上的很多人第一次意識到了環境危機。那一周,我們的談話大多圍繞著全球變暖或基礎設施抵禦災害能力不足帶來的危險等話題展開。在這場風暴中,曼哈頓地鐵站遭遇洪水襲擊,便是這種危險的例證。我們還清楚地看到,很多人都忘記了重要的電話號碼,因為我們已經習慣了把號碼記在手機通訊錄裡。我們對技術的依賴讓我們忽略了這些關鍵信息。

但我是在圖書館的時候才強烈地感受到,我們對虛擬關係的依賴有多麼嚴重。作為一個信息渠道,臉譜網在風暴中發揮了無可比擬的作用。短信成為快速更新加油站關門信息、向保險公司發送風暴損失照片等行動的最重要的手段。儘管在風暴期間,市民之間的親密度有所提升,但我們花在網絡社區進行與風暴相關的廣播的時間,遠遠超過了我們實際幫助鄰居所花的時間。我不太確定這些行為是否是某種應對機制,是否具有上癮特質,或者只是一種新現狀。儘管對技術的依賴不是一種新的行為,但在斷電的黑暗中淋漓盡致地表現了出來。

接受人類終將與機器結合的事實

我不想成為一個生活在恐懼中的人。我非常有幸擁有一位很了不起的妻子和一個幸福的家庭,還有給我的生活帶來意義的工作。我沒什麼好抱怨的。然而我總是能感受到很多人感受不到的情感,這讓我成了一名演員和作家。我的工作就是觀察人,然後把我所看到的東西忠實地表達出來。近來,當我開始觀察技術方面的問題時,我感到更多的是憂慮,而不是高興。作為一名技術作家,我比大多數人更瞭解先進機器的好處。但我對自己的人性情有獨鍾,而且我依然在努力跟宣揚人類終將被機器所代替的技術決定論做鬥爭。2014年4月我曾在Mashable網站上發表過一篇文章,題目為「接受人類終將與機器結合的事實」,我在文中是這樣描述的:

在對人工智能領域進行了如此多的研究之後,我仍然在十字路口徘徊。我為某些創新由衷地感到興奮,但也習慣了把自己的痛苦當作個人成長的關鍵。如今,算法變得如此先進,以至於人們可能再也沒有時間形成自己最純真的偏好,這是我難以接受的。這就好像我們已經到了某個階段,即當我們審視自己時,卻發現問題不只是我們不瞭解自己,而是我們無法瞭解自己。這依然會讓我感到深深的失落,人性是我尚未準備好放棄的東西。

我們都必須認真對待自己的道德觀。或者,至少應該嘗試去認真對待,哪怕這只不過是讓我們更好地去體驗我們所剩不多的時間而已。為了做到這一點,我們需要把生活中的屏幕統統關掉,好好地思考一下我們到底是誰。

互聯網廣告的恐怖谷

森政弘的恐怖谷理論的實際意義和後續影響在他給機器人或其他相關產品設計者所提出的建議中有所體現。他提議,可接受度的第一個峰值是設計可追求的有效目標之一。在這裡,可接受度數值相對較高,且與恐怖谷保持著相對安全的距離。對現實主義的追逐終將導致跌進恐怖谷的災難性風險。

這段引文來自題為「尋找恐怖谷」的一篇文章,作者是格拉斯哥大學心理學系的弗蘭克·E·波利克。這成了私下裡從事人工智能開發工作的人們的格言。它並不只是為了避免發明出太像人的機器人而令人驚恐。它更多地是要人們在人工智能的工作中,最大限度地追求「可接受度的高數值」。

這和廣告業中的個性化定位理念是同樣的道理。通過利用網頁瀏覽記錄、郵件和手機追蹤等手段,我們能看到的推送廣告都是建立在多重算法對我們生活的分析的基礎之上的。現在,我們大多數人都能理解這種邏輯關係:你給新出生的侄子買一次紙尿褲,然後在接下來的兩周都會看到幫寶適的廣告,儘管你自己的孩子早已經長大成人了。《石板》雜誌專欄作家法爾哈德·曼約奧曾在文章「互聯網廣告的恐怖谷」中寫道:「如今的網絡廣告對我們的瞭解不夠充分,不能避免一直向你推送那些你永遠也不會買的東西。但話說回來,他們確實對你瞭解得足夠多,不管你做什麼,都總有一種被監視的感覺。」

然而,意識到廣告商在監視我們,這還只是一種暫時的狀態。在愛德華·斯諾登的揭露下,數據隱私問題成了時代熱門話題,也讓我們的這種意識得到放大。雖然我們知道自己失去了對個人數據的控制力,但是我們依然缺乏嘗試保護它的動力。如今,各公司利用我們的這種倦怠心理,讓我們簽訂暗藏詭計的條款與條件,以達到其利用或出售我們個人數據的目的,這已經成為行業默認的規則。這種趨勢愈演愈烈,甚至在不久前《華盛頓郵報》報道的一項實驗中,有6名倫敦人通過同意一家虛構公司「條款與條件」中的「希律條款」(Herod clause),放棄了對其第一個孩子的永久所有權,以換取免費的Wi-Fi服務。

我們對揭露定義我們數字生活的算法缺乏熱情,為此,我們是要付出代價的。很快,我們就不會因為收到無關的推送廣告而感到惱怒了,而是會在廣告看起來更加精準的時候而忍不住吃驚地多看兩眼。目標定位將會變得細緻入微,足以避免「跌進恐怖谷」的風險,而且我們也將失去能夠意識到廣告的最後時機。當人們開始公開與我們互動時,應用於電腦和手機設備中同樣的技術也將在增強現實及虛擬世界中出現。正如摸清意圖就會在情感上激發我們的購買行為,將來我們的意圖和行為(比如在約會中)也會通過微軟全息透鏡或其他類似技術而被塑造。如果你想要直觀感受一下這將是什麼情形的話,你可以觀看Vimeo視頻網站上的短片《視線》。在該短片中,一名男子利用其約會對象的公開信息,並在她身上使用傳感技術,試圖騙她上床。該短片清晰地展現了未來基於操縱目的的目標定位非常可怕的面目。

正如我在引言部分提到的那樣,人與機器尚不明朗的結合正決定著人類將來的幸福。廣告恐怖谷效應是對我們未來幸福的最大威脅之一。從本質上來說,作為人類,我們並不是總能認識到哪些東西對我們的生活最有好處。我們可能做出糟糕的約會決定,或者選擇一份讓我們感到痛苦的工作。但是,我們能從自己的錯誤和行為中吸取教訓,這讓我們變得更成熟,也更好地定義了我們的幸福。正如積極心理學所表明的那樣,具有持久影響作用的,並不是伴隨愉悅快感(情緒正向峰值)而快速產生的多巴胺。內在幸福感是在具有挑戰性行為的框架中累積形成的。正是通過這些挑戰,我們才得以真正細緻地瞭解自己的內心。

在數字行為中,人們還有自己不願意承認的生活隱私。儘管我們可以通過社交媒體包裝自己的數字身份,但搜索記錄不會撒謊。如果一個人正忍受抑鬱症的折磨,而最先對此做出反應的卻是廣告商的算法程序,這看起來是否妥當?對於抑鬱症患者,我情願他接觸「學生生活」這樣的應用程序[該程序是由達特茅斯大學的安德魯·坎貝爾(Andrew Campbell)發明的],也不願他被廣告盯上。該應用程序的算法設計宗旨是為了測量一個人的通話、短信、睡眠模式和談話等信息。根據針對學生進行的一項選擇性實驗,該應用程序背後所使用的技術和在線精準定向廣告頗為類似,但前者的設計目的是為了按照診斷結果治療抑鬱症,而不是促進藥物的銷售。

除非我們能控制有關自己生活的數據,否則我們就得承受提心吊膽的折磨。在一篇發表於《大西洋月刊》的題為「數據幽靈與個人化恐怖谷效應」的文章中,薩拉·M·沃森(Sara M. Watson)描述了她朋友同樣的擔憂,指出:「我一直都不太確定臉譜網的廣告算法是否對我真的一無所知,又或者它對我的瞭解比我自己願意承認的還要多。」

決定我們在虛擬世界幸福與否的經濟學掌控在廣告算法和數據代理商的手中。如果這種經濟模式不被推翻,我們就必須承認它比我們更瞭解我們自己。

自然與人工的界限

我們現在正處於人類身份的定義方法不斷變化的過程之中。自然與人工之間的區分不再那麼明顯。人類的生活正在不斷超越自然世界。

科林·馬爾雄是紐約大學藝術學院電影電視製作專業的一名學生。當他為了自己的紀錄片《我們的技術身份危機》而主動採訪我的時候,我才開始對他的研究有所瞭解。在我為Mashable網站撰文時,我曾對他進行過採訪,前面的引文就出自那篇文章。從我們的對話中,我學到了很多,特別是他讓我認識到對他這個年紀(25歲)的人來說,人與技術完全結合的想法並不陌生,因為他們就是在互聯網中長大的。科林從7歲就開始在聊天室聊天,和別人建立起虛擬關係,就跟今天我們在臉譜網上進行的活動差不多。

尋找虛擬親密關係的想法促使科林開始對日本出現的一種流行趨勢進行研究。對此,他在我們的採訪中也有談到。目前,日本有很多年輕男子在「愛相隨」(LovePlus)等流行電子遊戲中結交了數字女友。以下為科林在採訪中對該趨勢的解釋:

情侶關係真的跟參與對像沒有太大關係,重要的是情侶關係本身在我們自己身上所產生的影響。這些男子把遊戲人物當成女友。她們存在於電腦中這一事實並沒什麼要緊的——重要的是,她能讓他感到快樂,而她本人是生物體還是技術就不那麼重要了。他已經獲得了他想從情侶關係中獲得的東西。

人們很容易對這些男子妄加評論,並為他們找不到「真正的」女友而感到難過。但正如科林指出的,如果他們在這種關係中能獲得真正的快樂,即便我們覺得其行為值得惋惜,我們又能給他們指出什麼出路呢?奪走他們的設備?刪掉他們的女友?要知道,自美國最高法院宣佈「企業也是人」開始,在今後多年裡,我們將一步步地進入面臨倫理、經濟和法律挑戰的時代。例如,如果一個人想要和電子遊戲中的人物結婚,並為其虛擬配偶索要合法身份地位時,我們憑什麼阻止他呢?

這已有先例可循。2009年,日本一位年輕男子娶了「愛相隨」裡的女友,舉行了史無前例的「人和電子遊戲的婚禮」。儘管「BoingBoing」(一個綜合博客網站)記者對故事的報道更多地把它當成一種表演藝術,而不是真事,但我們卻很難說這個婚禮是假的。觀看視頻的話,很難看出來新郎是否嚴肅對待這場婚禮。但有一點是毋庸置疑的,即他和他的朋友為這場人與機器的婚禮投入了大量的精力。這名記者還寫道,在舉行婚禮前,新郎特意與其他所有虛擬女友分手,只保留了未婚妻。如果這是真的的話,那這真可謂是跨越真實與虛擬世界的耐人尋味的道德演化的明證。如果一個人對他的虛擬配偶「不忠」的話,會有什麼要緊嗎?如果新郎真的出軌的話,他的這些行為會對其在電子遊戲或現實生活中的聲譽產生什麼影響?

在我的上一本書《入侵未來》中,我對「基於責任的影響力」進行了論述,我最早對這一概念進行研究是在2011年為Mashable網站撰寫的「為何社會責任會成為網絡新貨幣」一文中。我想測量一下我們在數字或虛擬世界留下的行為蹤跡會在多大程度上反映出我們的整體身份和人格。像億貝(eBay)這樣的公司都很推崇賣家評分的做法,即讓從陌生賣家那裡買東西的人對其客戶體驗進行打分。評分依據為賣家對自己責任履行的表現。他們的發貨速度快嗎?貨品狀況是否和賣家承諾的一致?在一個社區群體裡,信任的界限更加明晰,而賣家的輸贏則取決於買家對他的評價。

這種評分機制被許多屬於「共享經濟」行業領域的公司所採納。空中食宿(Airbnb)公司便是其中最有名的例子。這家公司可讓人們放心地把房子租給旅行者。租客租住私人房間或房屋,而不是住旅館,然後根據自身體驗進行評分。儘管眾口不一,空中食宿還是為租客制定了一套評分指南。正如其網站上標注的那樣,該指南注重「自由言論、公開透明和清楚溝通」的原則。它要求評分者實事求是,提供「能幫助社區更好決策,且對相關房東或租客有教育意義」的建設性信息。意思是說,空中食宿社區是在促使每個人承擔責任。房子或許非常不錯,而且位於一座非常美麗的城市,但如果房東對租客不好的話,其行為就會在評分中有所體現。同樣,備受歡迎與爭議的優步(Uber)租車服務公司也讓司機對乘客進行評分,從而讓司機們有權決定是否接送得到過差評的粗魯的、不守規矩的乘客。

這就是「基於責任的影響力」的核心概念。在信任社區裡,我們的行為反映了我們的人格。儘管我們可以在推特等社交網站上對自己進行包裝,但人們會對我們的行為產生何種反應不僅僅取決於我們所說的話。這種責任給我們提供了一面透明的鏡子,可讓我們重複某些行為,或改變我們覺得不能反應真實自我的一些行為。正是各種各樣的信任框架所具有的透明度使我們擁有成長的空間。正是這些與我們的行為相關的細節信息為我們提供了有深度的洞察,使我們能夠增強自己的幸福感。

每一次同步都是一次沉淪

恐怖谷效應給我們提供了一個獨一無二的機會,讓我們對自己必然死亡的命運以及與技術的關係進行深刻反思。上文有關羅布的故事片段已對此有所涉及,但我仍然在思索人們是否會願意和長相跟名人一樣的機器人約會。如果很多人都和酷似同一個名人的機器人約會的話,會不會很奇怪?對於曾當過演員的我來說,我也想知道這些名人會不會因此得到額外的酬金,即因其相貌被用於商業用途而獲得報酬。如果真可以的話,那丹澤爾·華盛頓可就要發大財了。

另外,我也想知道我的子孫該如何應對充斥著算法與機器人的約會大環境。諸如eHarmony(美國一家大型婚戀網站)等的社交網站已然極度流行,而且它們對大數據的利用程度比許多技術公司還要高。浪漫已經成為某種方程式了嗎?還要多久人們就會跳過媒人牽線搭橋的過程,而選擇直接把某種個性化算法植入或風度翩翩、或美麗動人的機器人框架中呢?

這些都是我們作為個人需要面對的問題。但在廣告恐怖谷效應方面,我們需要立場一致,呼籲個人數字身份的透明。不管我們選擇哪條道路,做決策的時機都是轉瞬即逝的。算法的發展速度異常迅猛,廣告恐怖谷效應很快就會消失。屆時,我們的思想便不再屬於我們,我們的意圖也要由他人定義。每一次同步,都意味著一次淪陷。

本章主要觀點總結如下:

我們的幸福感正在由我們被追蹤的方式決定。面對這個問題,我們有兩種選擇:

繼續利用現今充滿侵略性的秘密監控模式。算法和數據代理商對我們的瞭解比我們自己還要多。對我們的快樂或幸福的衡量,僅僅局限於我們線上線下的購買行為。

繼續利用現今充滿侵略性的秘密監控模式。算法和數據代理商對我們的瞭解比我們自己還要多。對我們的快樂或幸福的衡量,僅僅局限於我們線上線下的購買行為。

創造一個以信任環境為特點的新模型,在這種環境下,所有的交易方都要為自己的行為負責。每個人都有接觸個人數據的透明權利,每個人都有權對其幸福進行反思。在這樣的環境下,商業發展蒸蒸日上。

創造一個以信任環境為特點的新模型,在這種環境下,所有的交易方都要為自己的行為負責。每個人都有接觸個人數據的透明權利,每個人都有權對其幸福進行反思。在這樣的環境下,商業發展蒸蒸日上。

廣告恐怖谷效應不會持續很久。隨著優先算法的不斷改進,如果我們繼續沿著當前道路前行的話,我們終將看不到公司對我們生活追蹤的痕跡。就如同我們已經放棄了對個人數據的控制一樣,我們也將失去理解別人如何操縱並影響我們的幸福的邏輯能力。

基於責任的影響力將能提供技術上的透明。不論我們喜歡與否,我們被追蹤的行為都會以我們從未體驗過的方式,傳送到我們生活中的其他人那裡。這種暴露會激勵個人更好地控制個人數據,同時也讓人們有機會在技術的血雨腥風中更深刻地進行自我反省。